Microsoft a lancé il y a quelques jours l’avant-première de son « petit » modèle Phi-4, qui vise à marquer une percée. Le modèle doit rivaliser avec les plus grands du domaine, dont le Gemini 1.5 Pro. Mais là où des modèles comme GPT-4o de Google ou OpenAI peuvent gérer des centaines de milliards de paramètres, Phi-4 est limité à 14 milliards.

Microsoft souligne largement la grande efficacité de son modèle, avec des résultats supérieurs en termes de « raisonnement » mathématique. Performance que l’éditeur attribue à l’usage » données synthétiques de haute qualité « . Comme toujours avec les annonces de modèles, on n’en sait pas beaucoup plus sur ces données. Microsoft évoque également des améliorations au niveau du post-traitement, mais là encore sans plus de précisions.

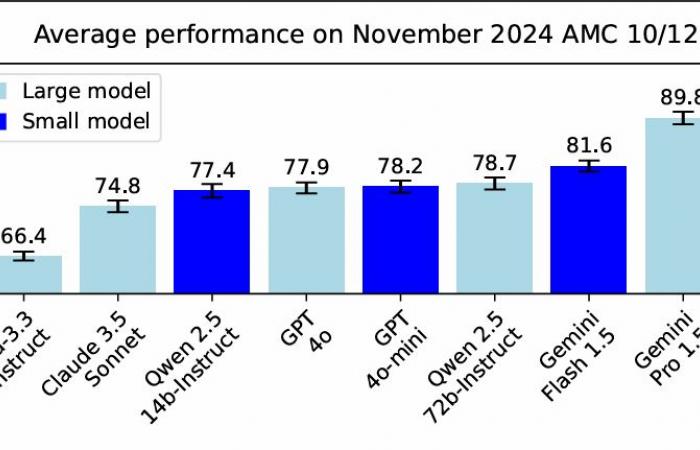

Phi-4 s’avère, selon Microsoft, particulièrement doué pour résoudre les problèmes mathématiques posés lors des concours de la Mathematical Association of America. Dans ce domaine, le nouveau modèle ferait mieux que les plus grands, voire leurs versions réduites qui peuvent être encore optimisées pour des besoins spécifiques.

Le nouveau modèle n’est actuellement disponible qu’en version préliminaire, avec un accès limité à Azure AI Foundry et à des fins de recherche uniquement, dans le cadre d’un accord de licence. Un lancement plus large aura lieu ultérieurement sur Hugging Face.

Phi-4 pourrait ouvrir un nouveau front dans une bataille qui jusqu’à présent était largement axée sur le principe « plus c’est gros, mieux c’est ». Le besoin en énergie et la facture énergétique pourraient devenir des facteurs limitants, ouvrant la voie à des modèles visant à faire plus (ou au moins autant) pour moins.